随着人工智能与计算机视觉技术的飞速发展,语音交互已成为数字时代的核心体验之一。嘴巴模拟器作为语音合成与唇形同步的关键工具,经历了从基础模型到智能系统的迭代升级。嘴巴模拟器4作为该领域的最新版本,整合了多项前沿技术,为用户提供了更精准、自然的语音与唇形匹配方案。

其核心功能聚焦于实时动态唇形生成与多维度情感表达。系统通过深度学习算法分析语音语流,自动匹配对应的唇部动作序列,支持多种语言和方言的精准同步。同时,用户可自定义情感参数,如开心、悲伤或惊讶等,系统会调整唇形张合、嘴角倾斜等细节,实现情感驱动的唇形模拟,增强交互的真实感。

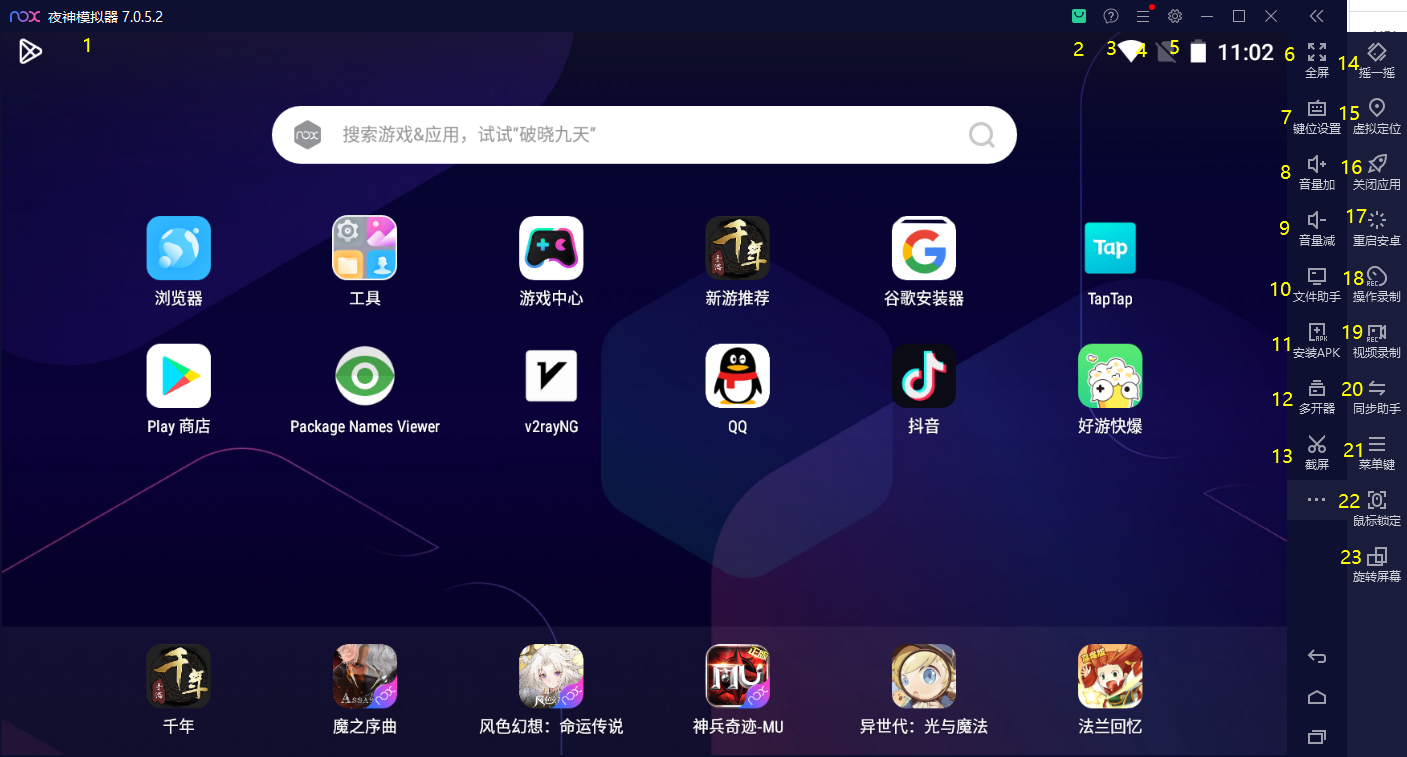

技术层面,嘴巴模拟器4采用了端到端的神经网络架构,结合3D人脸重建与动态纹理映射技术。模型通过海量语音与唇形数据训练,优化了唇部运动的连续性和自然度,减少了传统模型中常见的“卡顿”或“不协调”问题。此外,系统支持实时调整参数,如唇部大小、牙齿可见度等,满足不同场景下的个性化需求。

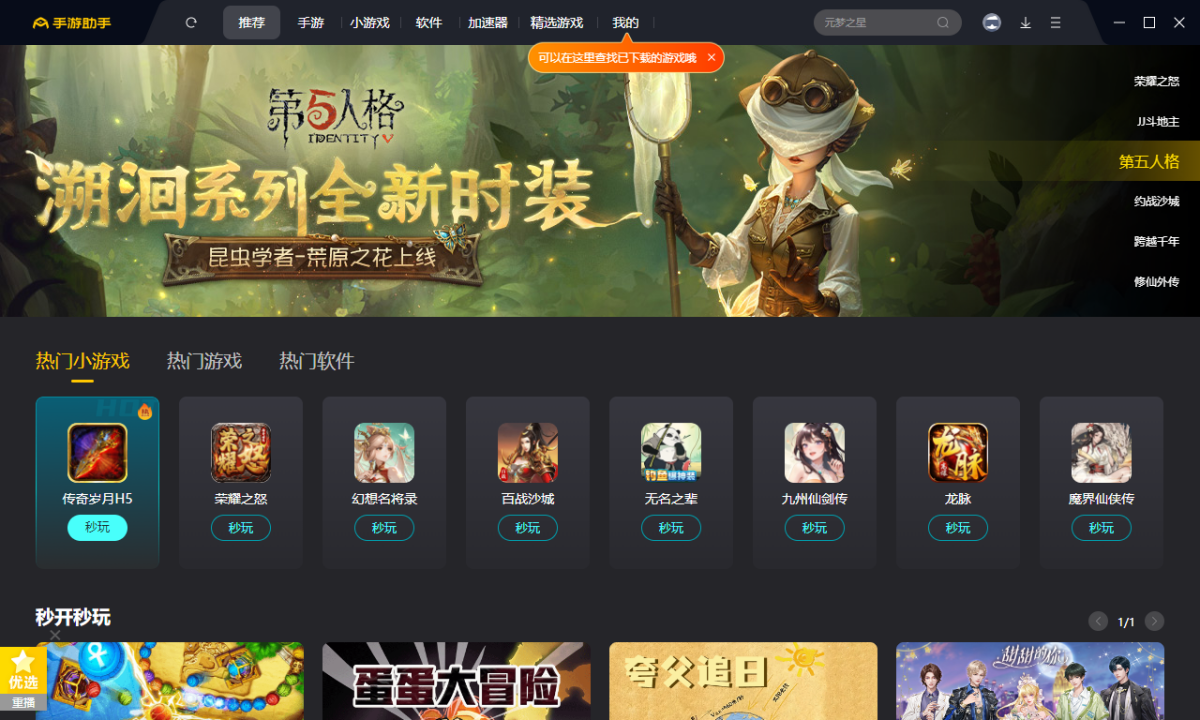

在应用领域,嘴巴模拟器4广泛用于影视制作、虚拟主播、教育训练等多个行业。在影视行业,可快速生成符合角色设定的唇形动画,降低后期制作成本;在虚拟主播领域,提升与观众的互动真实感;在教育领域,用于语言学习中的唇形模仿训练,帮助学习者掌握正确的发音和唇部动作。

市场反馈显示,嘴巴模拟器4显著提升了语音交互的沉浸感与效率。用户普遍认为其唇形同步的精准度高于前代产品,情感表达更丰富,且操作简便,降低了技术门槛。随着技术的持续迭代,嘴巴模拟器4有望进一步推动语音交互在更多场景的应用,成为连接虚拟与现实的桥梁。