声音模拟器是专注于声音生成与模仿的设备或软件,其核心功能是复制或模拟特定声音,旨在提供听觉体验的模拟,例如模拟动物叫声、历史人物的语音或环境音效。这类设备通常基于波形合成、语音合成等算法实现,技术路径单一,仅关注声音的频率、音调、节奏等参数的还原。

器人则是一种集成了感知、决策、执行等多模态能力的自主或半自主系统,其本质是具备环境交互与任务执行的综合功能,不仅包括声音输出,还涉及视觉、触觉、运动等多方面的能力。器人通过传感器获取环境信息,结合任务规划与控制算法,实现物理世界的交互与操作,声音是其多模态交互的重要组成部分,而非独立功能。

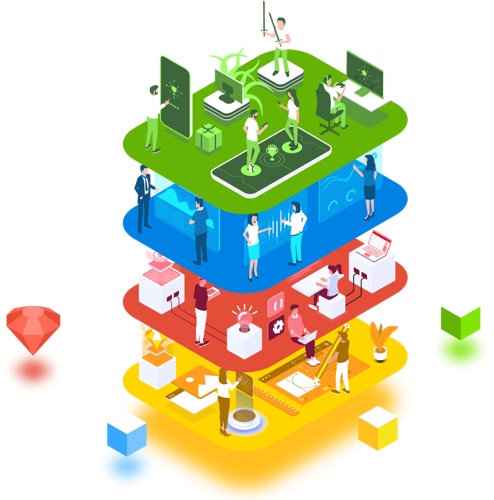

功能与系统的差异声音模拟器仅具备声音生成与模仿的功能,不涉及其他感官交互或物理操作,其应用场景局限于听觉体验的模拟,如娱乐、教育或测试。而器人需要整合多种功能模块,包括感知模块(视觉、听觉等)、决策模块(任务规划、路径规划)和执行模块(运动控制、操作执行),声音输出是其中的一环,服务于整体系统的交互需求。

从系统架构来看,声音模拟器是独立的模块化设备,其技术实现与器人无关,而器人的技术架构复杂,包含多个子系统,声音模拟模块是其中的一部分,需要与其他模块协同工作,实现多模态交互与任务执行。

技术实现的复杂性对比声音模拟器的技术实现相对简单,主要依赖算法(如波形合成、语音合成)生成声音,技术路径单一,不需要复杂的系统整合。而器人的技术实现涉及传感器融合、控制系统、人工智能算法等多个领域,技术架构复杂,需要多模块的协同与整合,声音模拟是其中的一环,需要与其他模块配合工作。

器人的技术发展依赖于多学科知识的融合,包括机械工程、电子工程、计算机科学等,而声音模拟器主要依赖音频技术,技术门槛相对较低,不具备器人那样的系统整合与多模态交互能力。

应用场景与自主性的差异声音模拟器的应用场景广泛但局限于听觉体验的模拟,如模拟动物叫声用于教育,模拟历史人物对话用于文化展示,或用于音频设备的测试与校准。这些应用场景不需要自主决策或物理操作,仅关注声音的生成与模仿。

器人的应用场景则涉及工业制造、服务、医疗、探索等领域,需要完成复杂的物理任务,如机械臂操作、服务接待、医疗护理等。器人具备自主决策与物理交互能力,能够适应复杂环境并完成自主任务,声音是其辅助交互手段,帮助器人与人类进行沟通,但不是器人实现任务的核心能力。

结论:声音模拟器不是器人声音模拟器不具备器人的多模态整合与自主任务执行能力,其功能仅限于声音的生成与模仿,不涉及其他感官交互或物理操作。器人是一种集成了感知、决策、执行等多模态能力的自主系统,声音输出是其多模态交互的一部分,而非独立功能。因此,声音模拟器不能被视为器人,二者在功能、系统架构、技术实现与应用场景上存在本质差异。