微笑mod模拟器作为模拟器领域的一种创新模组,核心聚焦于虚拟环境中情感表达的增强与自然化传递。它通过技术手段模拟人类情感传递机制,让虚拟角色能够根据场景和用户行为实时调整表情、姿态等,实现更贴近真实的情感互动,区别于传统模拟器中程式化或静态的情感表现方式。

从设计理念来看,该模组基于生物力学与计算机视觉技术,通过捕捉用户的面部微表情、肢体动作及语音语调等生理信号,转化为虚拟角色的动态情感表达。其核心目标是通过多模态数据融合,让虚拟互动更具情感层次感,帮助用户在模拟场景中更自然地感知与传递情感,提升虚拟体验的真实感。

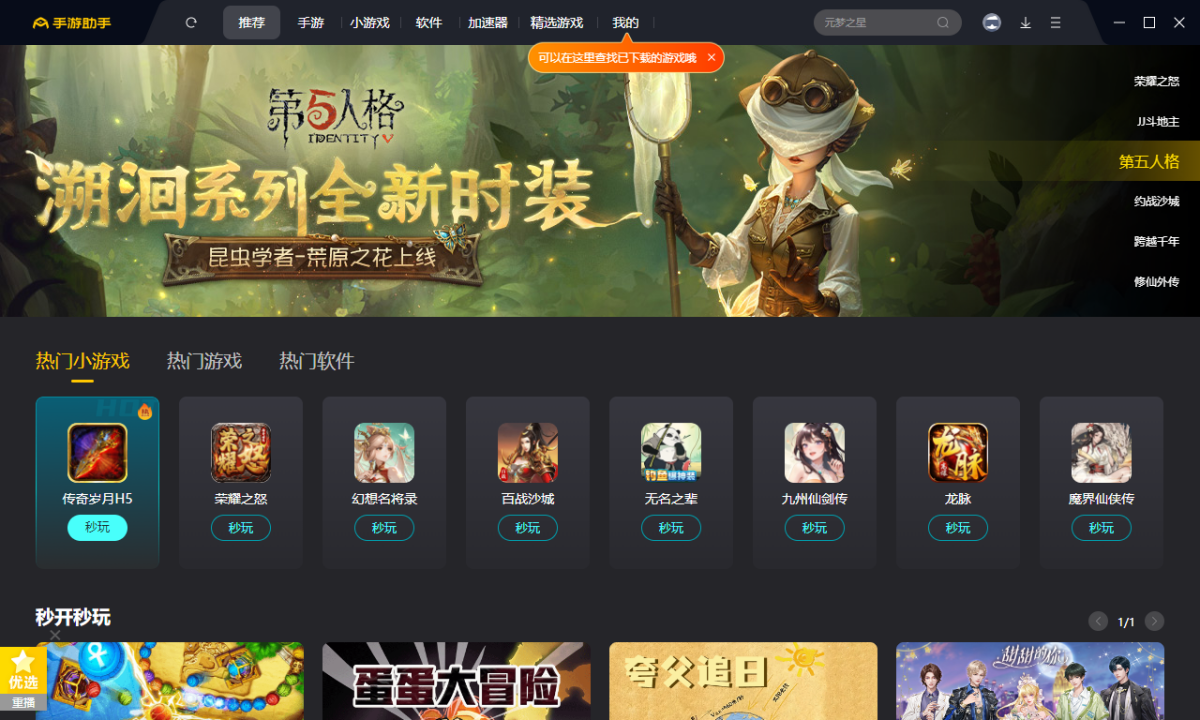

实际应用场景广泛且多样,在游戏领域,如角色扮演类游戏中,微笑mod能让NPC或队友根据玩家行为实时调整表情,增强剧情代入感与情感共鸣;在教育领域,可用于情感教育模拟,帮助学生理解不同情绪的表达方式与社交场景中的情感应对策略;在心理治疗中,作为辅助工具,帮助患者通过模拟社交场景进行情绪管理训练,积累实际社交经验。

技术实现层面,微笑mod采用多模态数据融合算法与深度学习模型,对用户的面部、声音、姿态进行实时分析,快速识别情感状态并映射到虚拟角色,确保情感传递的实时性与准确性。同时,通过持续优化算法与数据集,不断提升情感识别精度,让虚拟角色的情感表现更贴近真实情况。

用户反馈显示,使用微笑mod模拟器后,虚拟互动的沉浸感显著提升,用户更易产生情感共鸣,尤其在复杂情感场景(如冲突解决、安慰他人)中,模拟器的情感表现更贴近真实,有效帮助用户积累实际社交经验,提升社交技能训练效果。

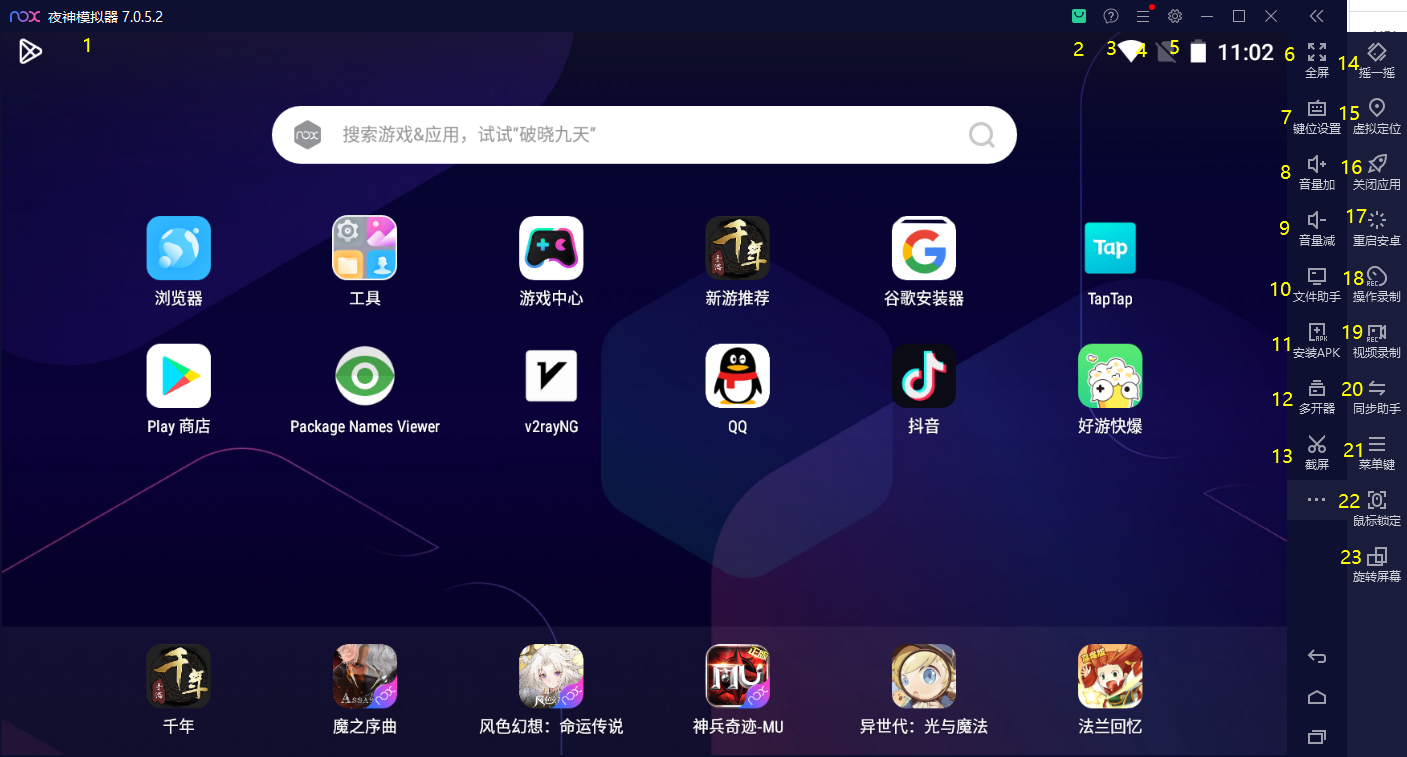

未来发展方向上,该模组将朝着智能化与跨平台化演进,结合AI生成对抗网络实现更逼真的情感生成,同时拓展至更多模拟器系统,让更多用户享受到情感交互的模拟体验,推动虚拟世界情感表达的进步与创新。