手人声模拟器是一种先进的技术系统,它能够将手部动作转换为可听见的语音。这项技术利用计算机视觉和人工智能算法,通过分析用户的手部姿势、手势和运动,来识别特定的意图或指令,并将其转化为自然语言输出。其核心思想是通过非语音的物理动作来控制语音的产生,为那些无法正常发声或使用传统输入设备的人士提供一种全新的沟通方式。

手人声模拟器的工作流程通常包含两个主要阶段。第一阶段是手势识别,系统会使用传感器(如深度摄像头或高分辨率摄像头)捕捉手部在三维空间中的位置和姿态。随后,通过复杂的计算机视觉模型,如卷积神经网络(CNN)或循环神经网络(RNN),对捕捉到的图像或视频流进行处理,以识别出特定的手势模式。第二阶段是语音合成,一旦识别出有效手势,系统会将该手势映射到预先训练好的语音模型中,从而生成相应的语音信号。整个过程需要大量的数据训练和优化,以确保手势与语音之间的准确对应关系。

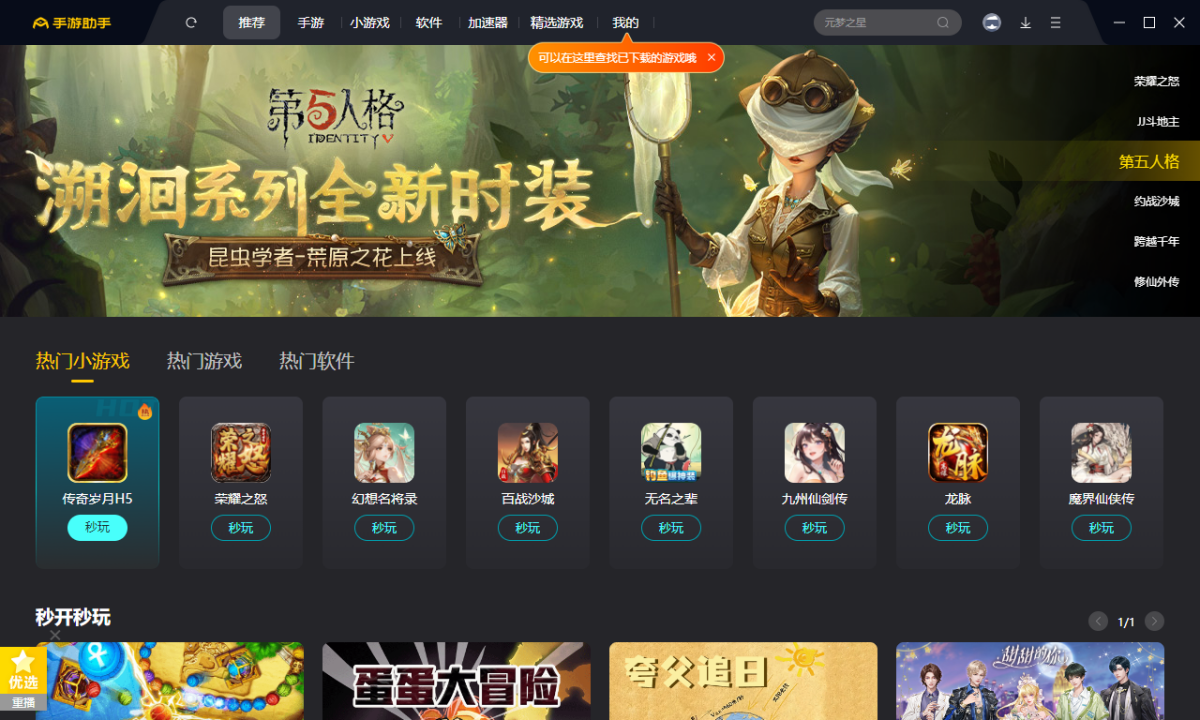

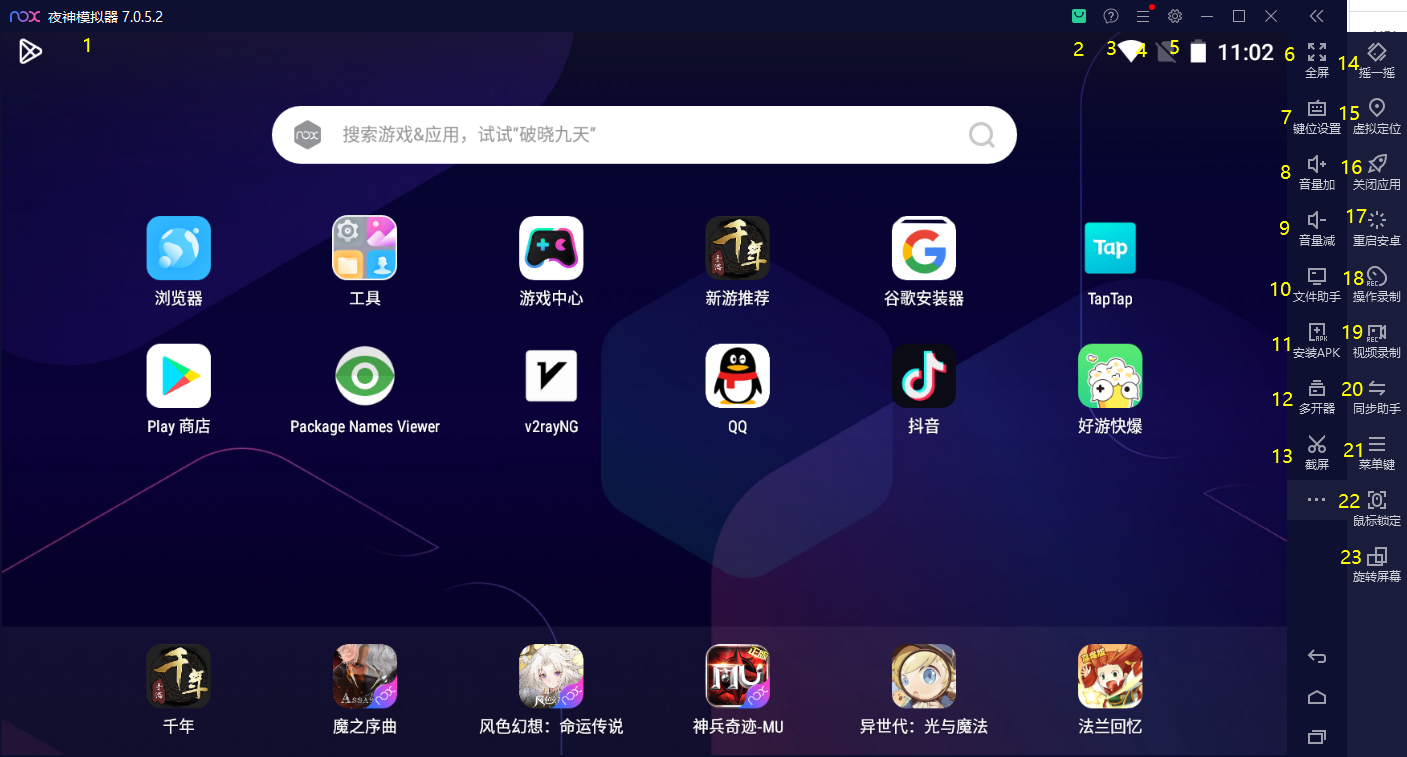

手人声模拟器在多个领域展现出广泛的应用潜力。在医疗健康领域,它为失语症患者、中风患者或神经肌肉疾病患者提供了重要的沟通辅助工具,帮助他们表达需求和意愿。在教育领域,该技术可用于开发互动式学习游戏,通过手势控制来增加学习的趣味性和参与度。在娱乐和游戏产业中,它为虚拟现实和增强现实应用提供了更直观的交互方式,用户可以通过手部动作直接与虚拟世界进行交流。此外,在无障碍技术领域,它为行动不便或身体有残障的用户打开了新的交互大门。

尽管手人声模拟器具有诸多优势,但也面临一些挑战。首先,其性能高度依赖于环境条件,如光照、背景复杂度和用户的手部特征。在光线不足或背景杂乱的环境中,识别精度可能会显著下降。其次,隐私问题也是一个重要考量,因为系统需要持续捕捉用户的身体动作数据。此外,当前技术的准确性和自然度仍有提升空间,有时生成的语音可能不够流畅或自然。最后,对于复杂的手势和意图,系统的处理能力可能不足,需要更强大的计算资源和更精细的算法模型。

随着人工智能和计算机视觉技术的不断进步,手人声模拟器的未来前景十分广阔。未来的系统有望实现更高的识别准确率和更低的延迟,使交互过程更加流畅自然。多语言支持将成为一个重要发展方向,让不同国家和地区的用户都能使用。同时,结合其他传感器(如眼动追踪或脑机接口)可以进一步提升交互的智能化水平。此外,随着硬件成本的降低和便携性增强,该技术有望从专业设备走向个人消费市场,成为未来人机交互的重要形式之一。

总而言之,手人声模拟器作为一种创新的人机交互技术,不仅为特定人群提供了重要的沟通工具,也为整个科技行业带来了新的发展机遇。它融合了计算机视觉、机器学习和语音合成等多学科知识,代表了未来人机交互向更自然、更直观方向发展的趋势。随着技术的不断成熟和完善,手人声模拟器有望在更多场景中发挥作用,深刻改变人们的生活和工作方式。