手模拟器视角锁定是一种通过模拟器界面与手部动作结合实现目标定位的技术,核心在于将人体手部运动或交互行为转化为数字空间中的精准目标锁定。这种技术融合了人体工程学与数字交互逻辑,旨在提升操作的自然性与效率。

从技术原理来看,手模拟器视角锁定依赖于传感器数据采集与算法处理。当用户通过手部动作(如手势、触摸、移动)与模拟器交互时,系统会实时捕捉手部位置、姿态等数据,并通过坐标映射、手势识别算法将这些物理动作转化为数字空间中的目标坐标。例如,在飞行模拟器中,用户通过手柄或手势控制手部指向目标,系统会根据手部姿态计算目标位置并实现锁定,整个过程遵循“手部输入→数据处理→目标匹配”的逻辑链。

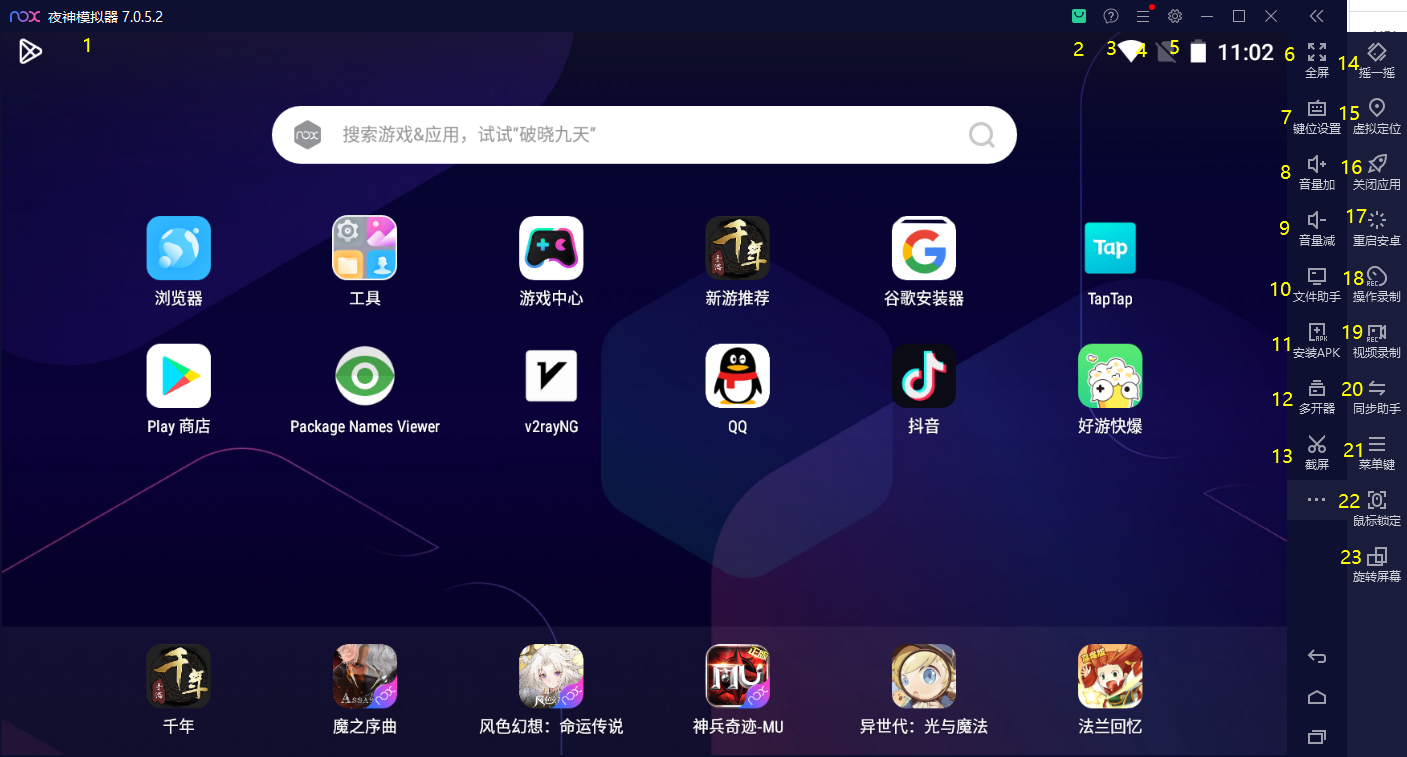

应用场景广泛涵盖游戏、工业控制、医疗模拟等领域。在电子游戏中,手模拟器视角锁定通过手势或触摸实现目标锁定,提升沉浸感与操作流畅性;在工业控制中,如机械臂模拟器,手模拟器视角锁定可精准定位操作对象,减少误操作风险;在医疗培训中,通过手模拟器视角锁定模拟手术器械定位,辅助医学生掌握精准操作技能。

优势方面,手模拟器视角锁定具备自然交互特性,符合人体习惯,相比传统按键锁定更直观;同时具备实时响应能力,能快速处理手部输入并更新目标状态,提升操作效率。此外,该技术可适应不同用户习惯,通过个性化设置调整手部动作与目标锁定的映射关系,满足多样化需求。

挑战主要来自传感器精度与算法优化。手部动作的微小变化可能影响目标锁定的准确性,尤其是在复杂场景中;此外,不同设备的传感器性能差异可能导致兼容性问题,需要针对不同平台优化算法。用户学习成本也是一项挑战,新用户需要时间适应手部动作与目标锁定的关联,但通过系统引导与反馈机制可逐步降低学习门槛。

未来趋势显示,手模拟器视角锁定将向多模态交互与AI优化方向发展。结合语音、触摸等多模态输入,可进一步提升交互的自然性与准确性;利用AI算法优化手势识别与目标匹配逻辑,可提高锁定精度与适应性。在虚拟现实(VR)场景中,手模拟器视角锁定将与空间定位技术结合,实现更沉浸式的目标锁定体验,推动数字交互技术的进步。