人物融合模拟器是一种融合计算机图形学、人工智能与大数据分析技术的创新工具,旨在通过技术手段将不同人物的特征、行为模式等进行融合,生成新的虚拟或现实可交互的人物形象。该模拟器通过分析大量人物数据(如面部特征、肢体语言、声音、行为习惯),构建人物特征模型,并利用生成对抗网络(GAN)等技术生成融合后的新形象,确保视觉和行为的自然过渡。

其技术原理核心在于深度学习算法的应用。系统首先收集并处理海量人物数据,提取关键特征(如面部轮廓、表情肌群、肢体运动模式等),构建高维特征空间。随后,通过GAN等生成模型,将不同人物的特征向量进行加权融合,生成具有新特征组合的虚拟人物。这一过程不仅关注视觉层面的融合,还涉及行为模式的匹配,确保融合后的人物在互动中表现出符合逻辑的决策和行为。

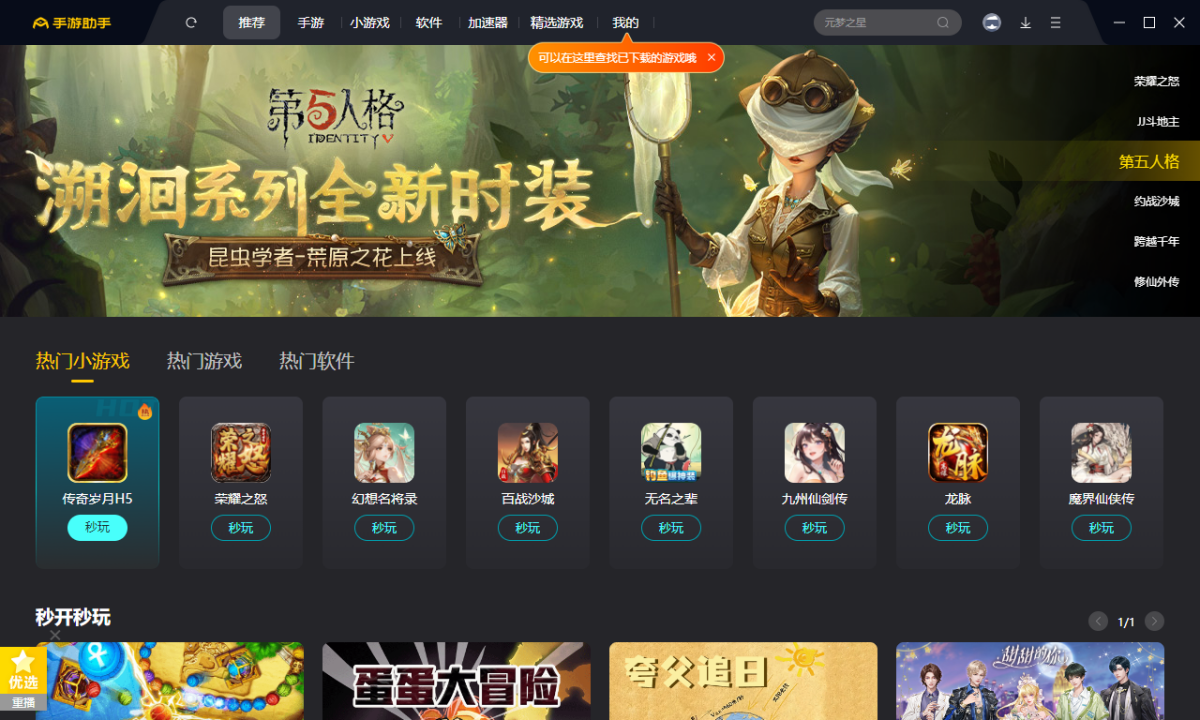

在应用场景上,人物融合模拟器已广泛应用于多个领域。在影视制作中,可用于快速生成角色原型或特效场景中的人物,例如科幻电影中的外星生物或历史剧中的古代人物;在游戏开发中,提升NPC的智能交互和个性化表现,让玩家感受到更真实的游戏体验;在教育领域,模拟历史人物或科学家的形象,增强学习者的代入感和理解深度;在心理学研究中,用于研究人物融合对认知和行为的影响,为相关理论提供实验数据。

相比传统的人物制作方式,模拟器具有显著优势。它大幅缩短了开发周期,降低了成本,同时提供了更高的灵活性和可定制性。例如,通过调整参数即可快速生成不同版本的角色,满足不同项目的需求,避免了传统制作中反复修改的繁琐过程。此外,模拟器还能处理传统方法难以实现的复杂场景,如多人物同时融合或动态环境下的行为表现。

然而,人物融合模拟器的发展也面临挑战与注意事项。数据隐私问题尤为突出,因为需要大量真实人物数据,如何保护用户隐私成为关键。目前,部分模拟器通过匿名化处理或使用合成数据来缓解这一问题,但仍需更完善的隐私保护机制。技术局限性方面,目前生成的融合人物在复杂场景下的表现可能存在不自然之处,如表情或动作的衔接问题,需要进一步优化算法和模型。伦理考量同样重要,人物融合可能引发身份认同或社会认知的争议,需要规范应用场景,避免滥用。

未来,随着AI技术的进步,人物融合模拟器的精度和自然度将不断提升,可能实现更真实的虚拟互动。结合增强现实(AR)和虚拟现实(VR)技术,用户可直接在现实环境中与融合人物交互,拓展应用边界。跨领域融合也是发展方向,如与生物技术结合,探索现实世界中的人物融合可能性,推动技术向更广泛领域延伸。