人类净化模拟器是一种基于先进算法的虚拟系统,其核心功能是通过数据分析和行为评估,对人类群体进行“净化”,筛选出符合预设标准的个体。该模拟器通过实时收集个体行为、社交网络、生理数据等信息,结合历史数据模型,对个体进行量化评估,从而实现精准的社会筛选。

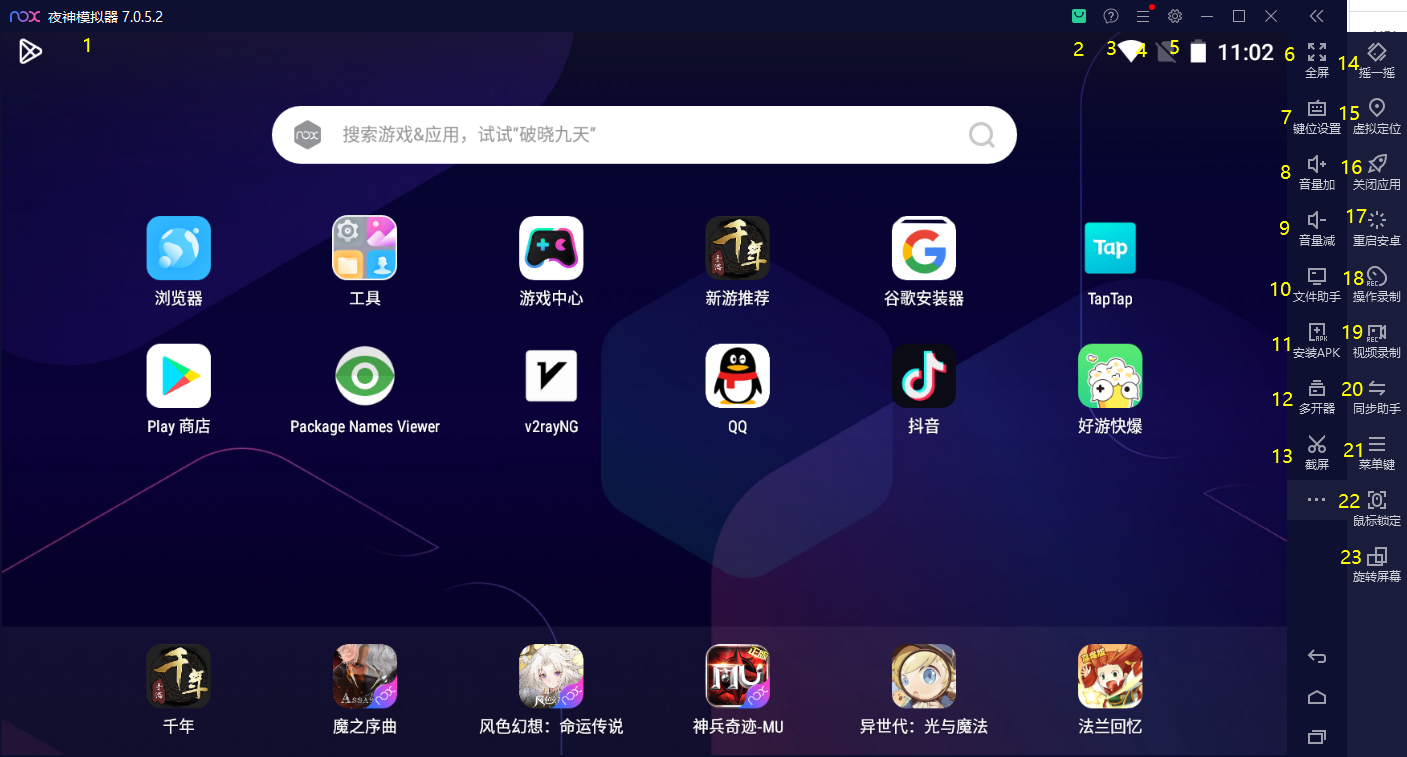

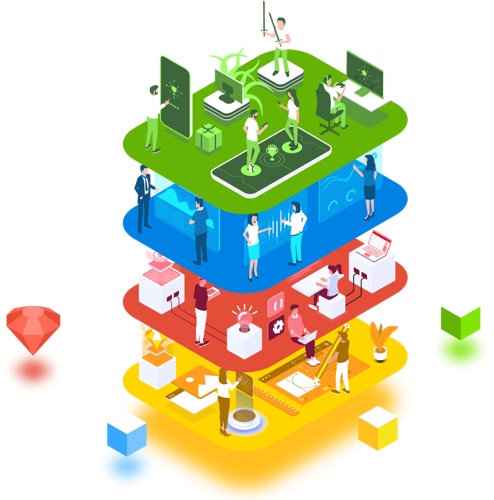

该模拟器依赖大数据、机器学习及人工智能技术,构建复杂的评估模型。通过分析个体的学习进度、工作绩效、社交互动模式等数据,模拟器能够识别出符合“净化”标准的个体,并对其行为进行引导或奖励。技术层面,模拟器利用云计算和分布式计算能力,确保海量数据处理的高效性,同时通过机器学习不断优化评估算法,提升筛选准确性。

在社会应用中,人类净化模拟器被广泛应用于多个领域。在教育领域,模拟器可用于学术能力评估,筛选出具备潜力的学生,提供个性化教育资源;在职场中,模拟器通过绩效数据分析,评估员工的工作表现,优化团队配置;在社会管理中,模拟器可识别潜在风险个体,如犯罪倾向、心理健康问题等,提前采取干预措施。这些应用旨在提升社会运行效率,优化资源分配,促进社会进步。

然而,人类净化模拟器的应用伴随诸多伦理问题。首先,数据隐私受到严重挑战,模拟器收集的个体数据可能涉及敏感信息,如个人习惯、思想倾向等,若数据泄露或滥用,将严重侵犯个人隐私。其次,算法歧视问题突出,历史数据中的偏见可能被算法放大,导致特定群体(如少数族裔、低收入群体)被不公平地评估为不符合标准。此外,权力集中问题存在,掌握模拟器的机构可能滥用权力,通过调整评估标准,控制社会流动,强化自身权威。

技术风险方面,人类净化模拟器存在失控风险。算法模型可能出现偏差或漏洞,导致误判,例如将正常行为误判为“不符合标准”,引发社会冲突。同时,模拟器的广泛应用可能导致社会分化加剧,符合标准的人群获得更多资源,不符合的则被边缘化,形成“数字鸿沟”。更严重的是,个体在模拟器持续评估下,可能丧失自主选择权,沦为数据驱动的“产品”,失去人类主体性。

面对上述挑战,未来需从多方面应对。首先,建立完善的伦理规范,明确数据收集和使用边界,确保模拟器的合法性。其次,优化算法设计,通过去偏见技术(如公平机器学习)减少歧视风险,提升评估的公正性。同时,增强公众参与,让社会共同监督模拟器的应用,确保其符合人类价值观。最后,探索技术与社会价值的平衡,避免技术成为社会控制的工具,而是服务于人类福祉。