全面模拟器数字人是具备高度拟人化特征与全面交互能力的数字实体,其核心在于模拟人类的感知、认知与行为,通过多模态数据融合实现与真实世界的无缝交互。与早期数字人仅限于文本或静态图像不同,全面模拟器数字人集成了语音识别、视觉处理、触觉反馈等多模态技术,能够理解复杂指令并做出自主决策,成为连接虚拟与现实的关键桥梁。

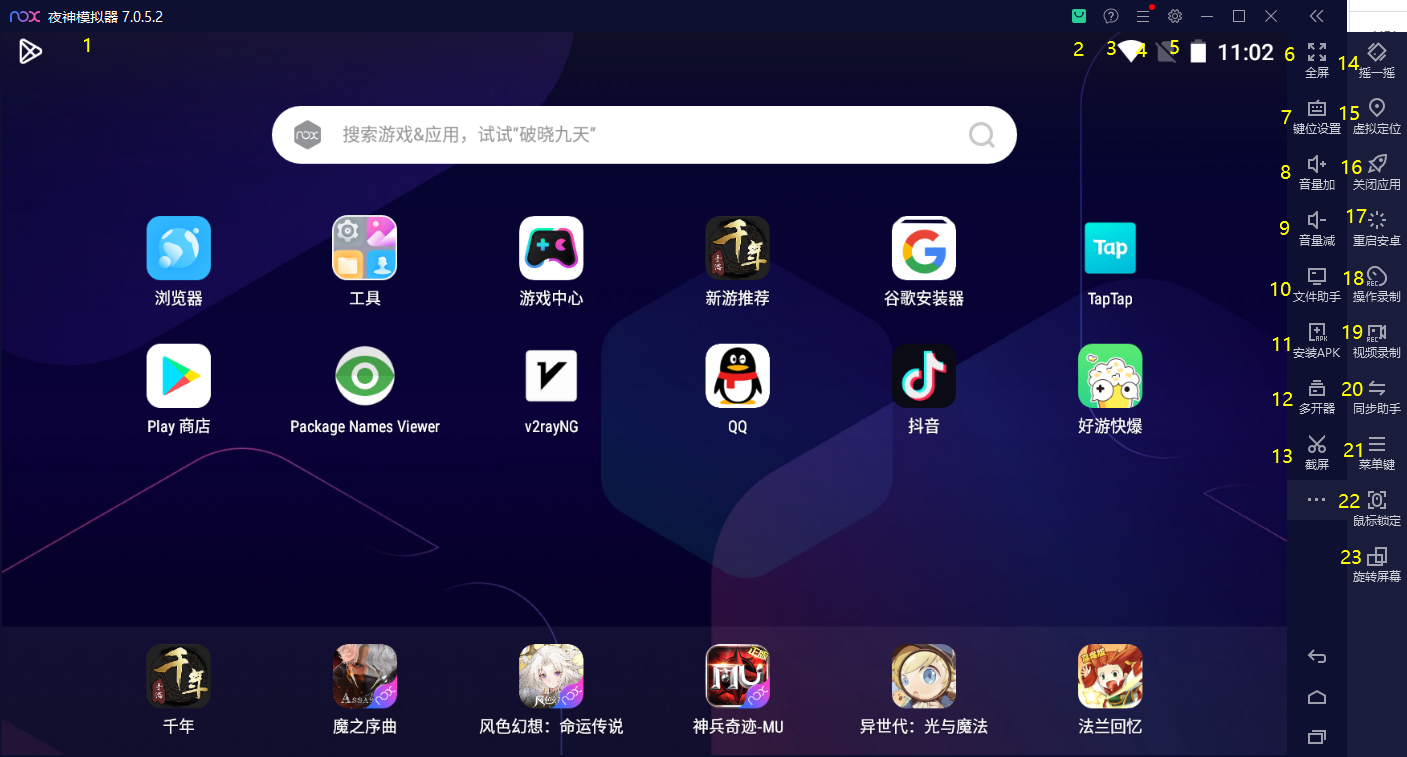

技术基础是全面模拟器数字人发展的核心支撑,主要包括三个层面:一是多模态AI模型,基于Transformer架构的深度学习模型能够同时处理语音、图像、文本等多种数据类型,实现跨模态理解与生成;二是传感器融合系统,集成摄像头、麦克风、力反馈传感器等设备,实时捕捉环境信息并转化为可处理的数据;三是自主决策算法,采用强化学习、决策树等模型,让数字人能够根据环境变化调整行为,逐步优化决策效率。

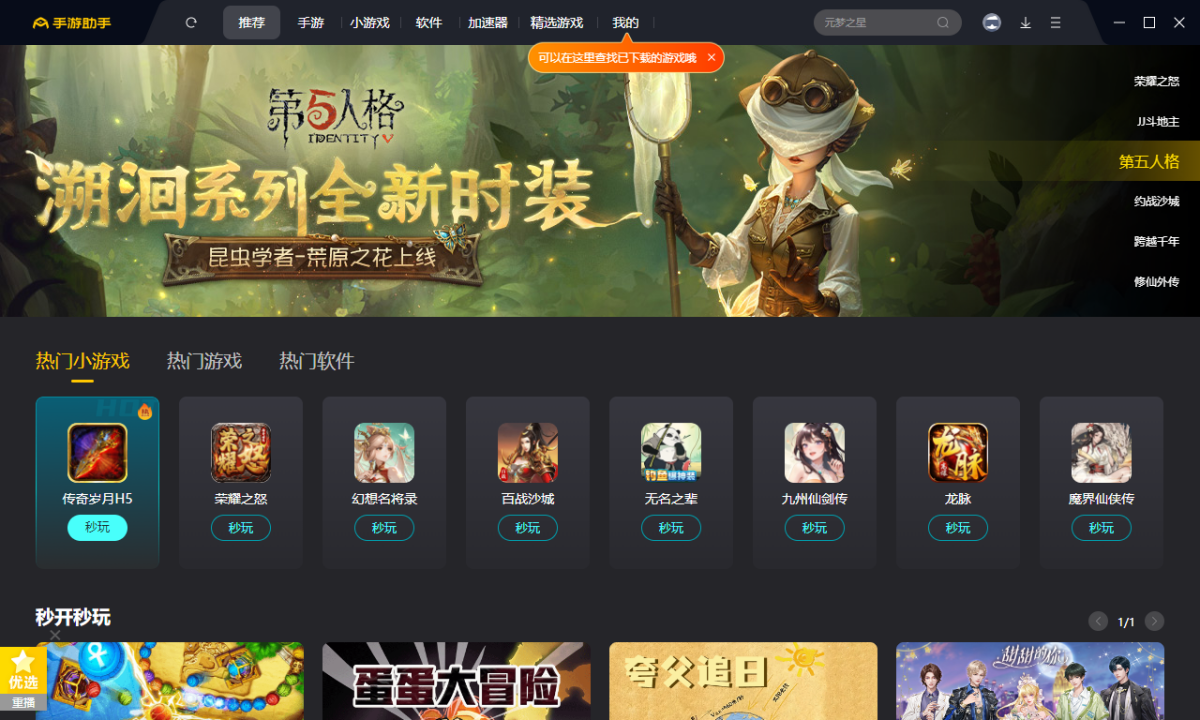

应用场景广泛且深入,覆盖多个领域。在虚拟客服领域,全面模拟器数字人通过多模态交互理解用户情绪与需求,提供个性化服务,如银行客服模拟人能够通过语音与表情判断用户焦虑程度,调整沟通策略;在内容创作领域,数字人可生成视频脚本、图像素材,甚至参与直播互动,如虚拟主播通过面部表情与手势增强观众代入感;在教育领域,个性化教学成为可能,数字教师可根据学生学习进度调整课程内容,模拟真实课堂的互动氛围;在医疗领域,辅助诊断系统通过模拟医生操作,提供手术模拟训练,降低实际操作风险。

尽管发展迅速,全面模拟器数字人仍面临诸多挑战。数据隐私与安全是首要问题,多模态数据收集与处理过程中,用户隐私泄露风险较高,需建立严格的数据保护机制;技术成熟度方面,当前模型的决策过程存在不可解释性,难以满足高精度应用需求,如医疗诊断需确保决策逻辑透明;伦理问题同样突出,数字人的自主性与责任界定模糊,若出现错误决策,责任归属需明确;此外,成本与性能平衡也是挑战,高精度传感器与AI模型的部署成本较高,限制了大规模应用。

未来趋势显示,全面模拟器数字人将在多个维度实现突破。物理形态模拟将更趋真实,通过新材料与运动捕捉技术,实现皮肤质感、动作流畅度的提升,增强用户沉浸感;自主决策能力将更强大,结合大语言模型与强化学习,数字人能够适应复杂环境,如模拟人类在突发情况下的应急反应;跨模态交互将深化,理解手势、表情、肢体语言等非语言信号,实现更自然的交互体验;与元宇宙的融合将成为重要方向,数字人作为虚拟世界的核心交互节点,推动虚拟与现实的无缝衔接,成为数字经济发展的重要引擎。